Secure-by-Design untuk Keamanan Sistem AI

Perkembangan Artificial Intelligence (AI) telah membuka peluang besar bagi dunia bisnis, dari peningkatan efisiensi operasional hingga lahirnya berbagai inovasi. Namun, di balik perkembangan tersebut muncul pula tantangan baru yang tidak dapat diabaikan, yaitu risiko keamanan siber yang semakin tinggi dan kompleks.

Seiring dengan semakin meluasnya adopsi AI, attack surface atau permukaan serangan juga ikut bertambah. Sederhananya, attack surface adalah setiap titik atau celah dalam sebuah sistem yang dapat diterobos dan dirusak oleh pihak-pihak yang tidak bertanggung jawab. Dalam konteks AI, celah-celah tersebut bisa berupa aplikasi, data-data yang digunakan, model yang dijalankan, hingga integrasi dengan sistem lain. Semakin kompleks dan saling terkoneksi sebuah sistem, maka semakin besar pula potensi celah yang bisa dimanfaatkan.

Di sinilah pentingnya membangun strategi keamanan yang tidak hanya reaktif tetapi juga proaktif melalui pendekatan secure-by-design.

Risiko Ancaman Siber pada Teknologi AI

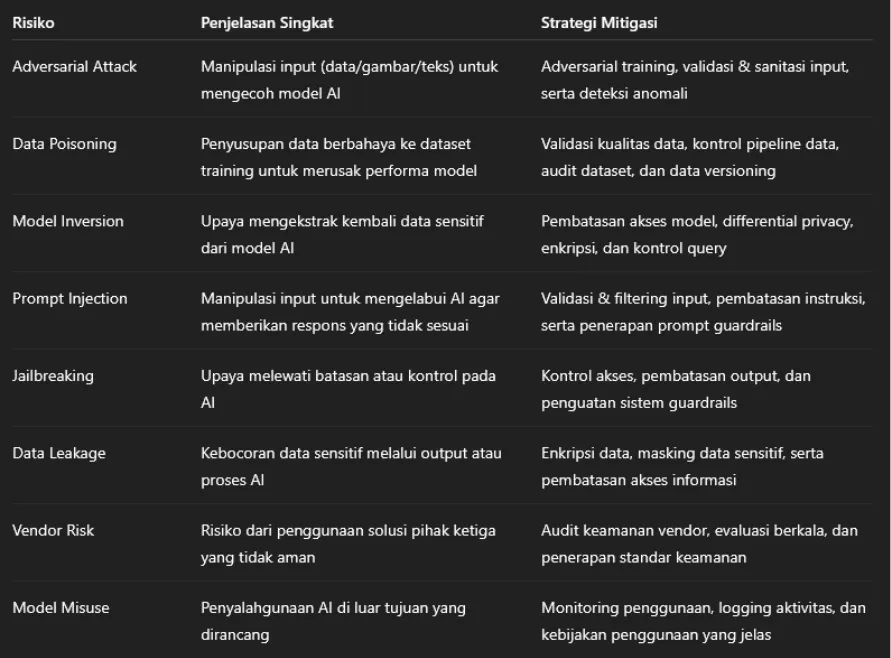

Berbeda dengan sistem IT konvensional, AI menghadirkan jenis ancaman baru yang lebih kompleks. Beberapa di antaranya meliputi:

Adversarial Attacks

Adalah teknik untuk “menipu” model AI dengan cara memanipulasi input yang diberikan. Perubahan yang dilakukan biasanya sangat kecil dan tidak terlihat oleh manusia, tetapi cukup untuk membuat model menghasilkan output yang salah.

Contohnya sebuah sistem pengenalan gambar dapat mengidentifikasi rambu lalu lintas dengan benar. Namun, dengan sedikit perubahan pada gambar (misalnya menambahkan pola tertentu), AI bisa salah mengenali rambu “Stop” sebagai “Speed Limit”.

Data Poisoning

Adalah upaya menyisipkan data yang salah atau berbahaya ke dalam proses training AI. Training itu sendiri adalah proses di mana model “mempelajari” kumpulan data untuk mengenali pola dan membuat keputusan. Jika data yang digunakan untuk training sudah tercemar, maka model yang dihasilkan juga akan belajar dari informasi yang salah dan menghasilkan keputusan yang tidak akurat.

Contohnya dalam sistem deteksi email spam. Jika penyerang sistem memasukkan banyak data email spam yang dilabeli sebagai “bukan spam” ke dalam dataset training, maka AI bisa salah mengklasifikasikannya sebagai email yang aman.

Model Inversion

Adalah teknik untuk merekonstruksi atau menebak data asli yang digunakan untuk melatih model AI dengan cara menganalisis output yang dihasilkan. Penyerang sistem tidak perlu mengakses data secara langsung, tetapi cukup dengan “bertanya” ke model berulang kali untuk mendapatkan gambaran dari data yang pernah digunakan saat training.

Contohnya pada model pengenalan wajah, penyerang dapat mencoba merekonstruksi wajah seseorang berdasarkan output model, meskipun tidak memiliki akses langsung ke data gambar asli yang digunakan saat training.

Ancaman terhadap sistem AI dapat berasal dari berbagai pihak, baik dari dalam maupun luar organisasi, mulai dari kelompok hacktivist, kejahatan siber terorganisir, ancaman orang dalam (malicious insiders), hingga kelompok siber yang didukung suatu pemerintahan untuk agenda tertenu. Masing-masing memiliki tujuan, kapasitas, dan metode yang berbeda-beda dalam mengeksploitasi kerentanan sistem.

Karena itulah, organisasi perlu memahami secara menyeluruh lanskap ancaman yang bakal dihadapi, termasuk jenis serangan yang mungkin terjadi, potensi permukaan serangan dalam sistem, serta aset mana yang paling berisiko.

Risiko Lainnya dari Vendor dan Teknologi Pihak Ketiga

Dalam implementasi AI, organisasi juga sering kali menggunakan solusi dari vendor eksternal. Namun, penting untuk memahami bahwa risiko keamanan juga dapat berasal dari pihak ketiga.

Jika vendor tidak menerapkan standar keamanan yang baik, maka kerentanan tersebut dapat berdampak langsung pada organisasi. Beberapa risiko yang perlu diwaspadai antara lain:

- Prompt injection

Adalah teknik manipulasi input pada AI (terutama chatbot atau generative AI) untuk “mengelabui” sistem agar memberikan respons yang tidak semestinya atau membocorkan informasi tertentu. - Jailbreaking

Adalah upaya untuk melewati batasan atau kontrol yang sudah ditetapkan pada AI, sehingga sistem dapat menghasilkan output yang seharusnya dibatasi atau tidak diizinkan. - Data leakage

Adalah kondisi di mana informasi sensitif secara tidak sengaja terekspos melalui sistem AI, baik melalui output model maupun proses pengolahan data.

Oleh karena itu, proses evaluasi vendor menjadi langkah krusial dalam penerapan strategi keamanan AI.

Secure-by-Design: Membangun Keamanan Sejak Tahap Desain

Banyak organisasi masih memandang keamanan sebagai tahap akhir dalam proses pengembangan sistem. Padahal, pendekatan semacam ini justru meningkatkan risiko karena potensi kerentanan lain sering kali baru teridentifikasi setelah sistem hampir selesai dibangun.

Pendekatan secure-by-design menawarkan perspektif yang berbeda, yaitu dengan mengintegrasikan keamanan sejak tahap perencanaan dan pengembangan. Dalam pendekatan ini beberapa hal yang diimplementasikan di antaranya:

- Sistem dirancang dengan keamanan sebagai fondasi utama

- Risiko diidentifikasi sejak tahap awal

- Kerentanan diminimalkan sebelum sistem digunakan

Pendekatan ini tentu tidak hanya memperkuat perlindungan terhadap sistem, tetapi juga menghemat biaya jangka panjang karena mengurangi kebutuhan perbaikan setelah sistem beroperasi.

Strategi Keamanan AI yang Perlu Diterapkan

Untuk menghadapi risiko-risiko keamanan AI yang sudah dijabarkan sebelumnya, organisasi perlu menerapkan strategi keamanan yang tepat dan terstruktur.

Dengan strategi mitigasi risiko AI yang tepat, organisasi tidak hanya menghindari ancaman, tetapi juga membangun operasional yang lebih stabil, aman, dan terpercaya. Pendekatan ini dapat menjaga akurasi output serta mendukung pengambilan keputusan yang lebih andal agar bisnis dapat berkembang lebih cepat, inovatif, dan tetap kompetitif.

Di era AI, keamanan bukan lagi sekadar pelengkap, melainkan bagian inti dari strategi bisnis. Pendekatan secure-by-design dapat membantu organisasi mengantisipasi risiko sejak awal sekaligus menjaga sistem dan data tetap aman.

Dengan strategi yang tepat, perusahaan dapat memaksimalkan potensi AI tanpa mengorbankan keamanan dan kepercayaan.

Untuk itu, dibutuhkan mitra teknologi yang tidak hanya fokus pada inovasi, tetapi juga memahami aspek integrasi dan keamanan. Neuronworks siap membantu bisnis Anda mengembangkan dan mengoptimalkan solusi AI secara aman dan terarah.

📩 Email: marketing@neuronworks.co.id

🌐 Website: www.neuronworks.co.id

📞 WhatsApp: +62 811-2127-696

Have any question?

Have any question?